NVIDIA представила DLSS 5 — новую версию своей технологии рендеринга картинки на основе ИИ. И в этот раз компания явно перегнула палку, так как практически все примеры «улучшенных» с помощью DLSS 5 игр стали больше походить на сгенерированные нейросетью изображения в плохом смысле.

В NVIDIA называют DLSS 5 «самым значительным прорывом компании в области компьютерной графики со времён дебюта трассировки лучей в реальном времени» в 2018 году. Новая версия DLSS отрисовывает пиксели с фотореалистичным освещением и материалами, «стирая грань между игрой и реальностью». С помощью этого инструмента разработчики смогут создавать картинку уровня голливудских блокбастеров, уверены в NVIDIA.

DLSS 5 способна анализировать сложные сцены всего по одному кадру, чтобы мгновенно понять, где находятся персонажи, как лежат волосы и ткань, откуда светит солнце и так далее. С этими знаниями технология достраивает изображение с улучшениями, сохраняя исходный смысл сцены.

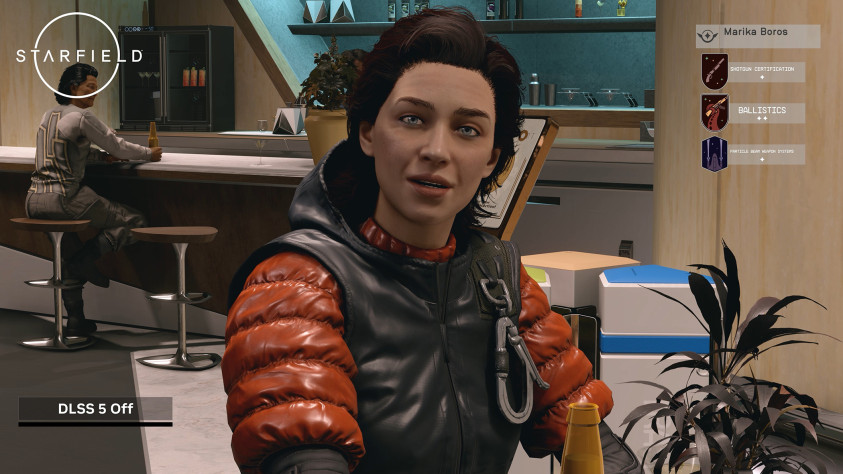

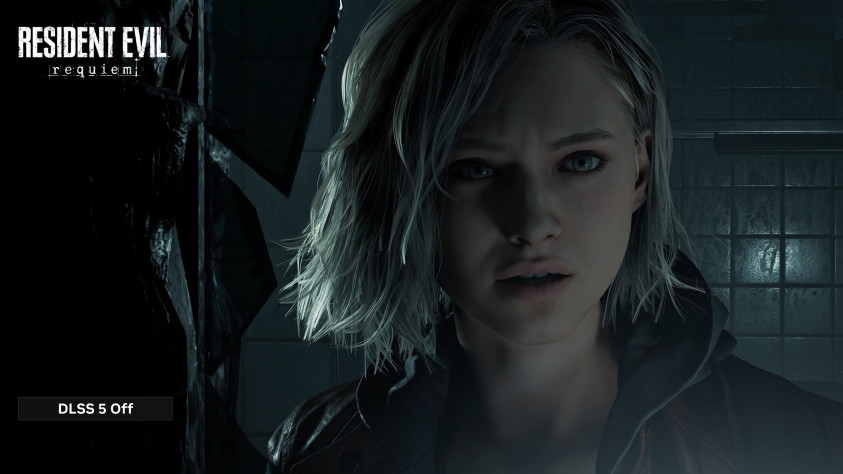

Технологию уже вызвались поддержать крупные студии вроде Bethesda, Capcom, Ubisoft, Warner Bros. Games и NetEase. После запуска DLSS 5 будет работать в целом наборе игр, среди которых Resident Evil Requiem, Assassin’s Creed Shadows, Delta Force, Hogwarts Legacy, Starfield, The Elder Scrolls IV: Oblivion Remastered, Where Winds Meet и другие.

В NVIDIA уточнили, что девелоперы могут гибко управлять эффектами DLSS 5, чтобы картинка оставалась верна изначальной задумке: «Это не фильтр — DLSS 5 „скармливает“ модели цветá и векторы движения из каждого кадра, так что итоговая картинка всегда привязана к исходной 3D-сцене».

Запуск технологии состоится осенью 2026-го на видеокартах RTX 50-й серии. По мнению редакции Digital Foundry, специалистам NVIDIA предстоит серьёзно поработать над оптимизацией DLSS 5. Только для демонстрации компания использовала одновременно две RTX 5090 — на одной запускали игру, а на второй работала DLSS 5. Тем не менее, технология спроектирована так, чтобы функционировать на одной видеокарте.

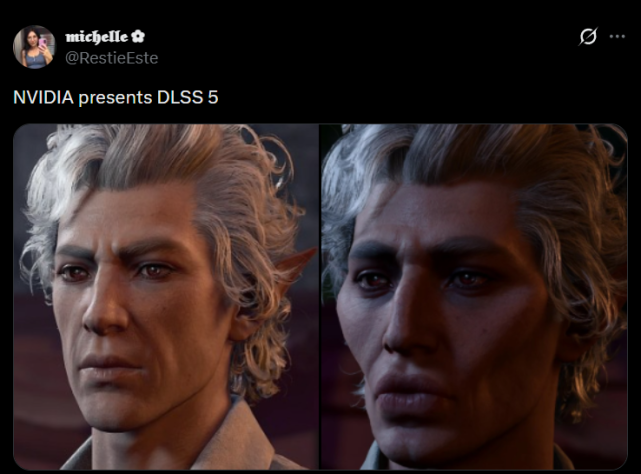

Если верить NVIDIA, разработчики дали положительную обратную связь о DLSS 5. Однако значительная часть СМИ, представителей индустрии и простых пользователей новинку, мягко говоря, не оценили. «Во время просмотра трейлера меня не покидала одна мысль: „Всё это выглядит точно так же, как первая картинка, которую я сделал в нейросети“», — поделился журналист Windows Central Майкл Хоглунд (Michael Hoglund).

И комментариев, приравнивающих итог работы DLSS 5 к посредственным нейросетевым художествам, предостаточно. Сообщество раскритиковало как отрисовку персонажей в частности, так и общий баланс яркости, контрастности и резкости изображения. Кроме того, местами лица персонажей перестают быть похожими на оригинал — к примеру, Грэйс из Requiem будто подкачали губы, а протагонист Hogwarts Legacy стал выглядеть сильно старше своих лет.

Это НЕ ТО направление, в котором должны развиваться игры. В каждом кадре художественный замысел принесли в жертву бессмысленным «деталям». Любой кадр с DLSS 5 проигрывает оригиналу по характеру и выразительности. Просто безвкусный ИИ-фильтр. Давайте не будем заниматься этой чушью.Джефф Талбот (Jeff Talbot), старший концепт-художник в Gunfire Games

«Узри, Перри Утконос — мой нейрослопинатор!» — пошутил пользователь под видео с показом DLSS 5. После урагана из язвительных высказываний и критики как минимум в Bethesda пообещали откорректировать эффекты DLSS 5, чтобы добиться наилучшего результата.

Лучшие комментарии

Как же я с этого порвался xD

Литералли

Пользуясь случаем, хочу отметить в комментариях, что я хуже говна в жизни не видел.

Ну что за люди. Столько негатива. Прекращайте, я уже устал лайкать

Навалили кринжа)

Будущее не остановить,)

Ну и позорище.

И из-за этого одна плашка памяти DDR5 на 8 гигабайт стоит 12 тыс. рублей. И речь идёт даже не о каком-нибудь Kingston Fury Beast.

Чего прикольного в том, что силами NNВИДИИ почти все пиксели экрана рисуются нейронками? 1080p60 -> 4k360(x4 upscale, x6 framegen), игра через ВИДЕОкарту буквально рисует 4% от итогового результата. А теперь и того меньше. Теперь можно забить не только на оптимизацию, но и на арт, стиль, проработку освещения, только заплати 79.99$

Первый раз вижу, чтобы НВидиа, увидев поток критики, закрепила под своим роликом специальный оправдательный комментарий.

А, ну и да.

Мы получим Реалистичную ГТА до выхода ГТА6.

Картинки с DLSS5 как будто прогнали через ИИ-фильтр без лучшения качества. Персонажей заменили на ии-куклы: Грейс на саму себя не похожа, морда у всех однотипная и плоская, вокруг фигур избитая ии-шная тень. В Nvidia этот "обязательно успешный продукт" уже всем так глаза замылил, что он заменил им реальность? Иначе не знаю, как можно одобрить эту подмену понятий

Хотелось бы заявление от какого-нибудь крупного издателя, что такое мы не добавим в наши игры. Мне сложно представить кого-то, кому нужна будет эта технология. Она же попросту ломает весь арт дизайн. Лучше на минималках, чем вот с этим. Проходил недавно первый масс эффект первую часть. Текстуры не сверх разрешения, нету рейтрейсинга, нанитов и т.п., но игра и без этого всего выглядит красиво. Именно, что красиво, но по идее нвидиа, туда надо этот AI фильтр запихнуть, чтобы было "реалистично". Но кому нужен этот реализм, не очень понятно.

Вы не понимаете, это будущее.

Вот ради этого RAM стоит по $1000+.

Ну куда человечество свернуло, а. Что если мы все умерли в 2020 во время Ковида и сейчас в аду? Почему всё хуже и нет перспективы на лучшее.

Ну вообще да, это арт-дизайн. Иногда он неудачный а иногда откровенно хреновый. А вместо того чтобы пытаться его "исправить" с помощью нейронок, как по мне лучше просто не играть в игру.

В комбо с деревянной мимикой в большинстве игр, будет выглядеть всрато в любом случае.

Когда я увидел реакцию Давида Яффе на эту презентацию (он, если что двумя руками за DLSS 5 и назвал всех геймеров сумасшедшими идиотами, которые не видят очевидного улучшения), то сразу вспомнил недавнее фото экранизации God of War и что-то стало так грустно от того, что даже некоторым разработчикам (и известным так-то) плевать на художественное видение в их же собственных работах, лишь было максимально реалистично и графонисто, даже, если результат выглядит, как куча второсортного говна. Но зато это же супер реалистичное второсортное говно.

Кстати, как же бесит, что для демонстрации "визуальных улучшений" компании продолжают в наглую читерить и в качестве оригинального изображения Грейс из RE9 взяли ее модельку с самыми низкими настройками графики, ибо на PC и на ультрах она выглядит намного лучше, чем в презентации. Никто на это особо не обратил внимания, как и на то, что их алгоритм реально накосячил в изображении какой-то бабульки (не знаю - не играл) из Hogwarts Legacy. Там не только морщины выглядят плохо, но и на стопкадрах видно, что ИИ принимает тень от палочки, которую не видит за цвет кожи этой бабульки. Приколы генерации по одному кадру.

В целом, нам нужно лишь продержаться в течении следующих лет пяти пока они не допилят эту технологию. Пять лет нейрослопного говна ради светлого будущего супер реалистичного гейминга. Правда зачем NTE (аниме-GTA гача, что поддержала технологию) супер реалистичный фильтр я понятия не имею...

Как же я люблю людей с непомерным эгом: "Я голос истины, а если меня и закинут дизами, то это противники технологий виноваты, но я всё равно прав".

Если всецело поощрять такие технологии по генерации кадров, даже в лучшем виде, что доступны на топовом железе, то мы можем в будущем столкнутся с тем, что разработчики могут абсолютно плюнуть на оптимизацию и вообще забыть как это делается и полагаться на технологии. В итоге, игра будет играться нормально на крутых железках, а на других, ну простите, что она не тянет или у вас минимум кадров, вы не знали, что гейминг - это премиальное хобби?

Та и в целом, я против полного создания чего-то с помощью ии, нейронки должны упрощать работу, ускорять, но оставлять место человеку. У нас уже множество ситуаций, где начальство сокращает работяг, ведь ии дешевле и практичнее. Мол, зачем нам джуны ? А это абсолютно неверная позиция, не будешь давать джунам работы - не вырастут мидлы и сеньоры, что смогут проверять работу ии, если вы уж пошли путём траты малых ресурсов на персонал. Технологии нейронок останутся, но мы должны жёстко регулировать их использования, чтобы ими пользовались правильно, а не злоупотребляли ими и видели в ней панацею всему.