«Могут ли машины думать?»Алан Тьюринг

Что если ваш телефон сольет ваши данные в сеть? Или тостер вместо того, чтобы просто поджарить тост, подожжет всю квартиру? А может машина с автопилотом утопит себя вместе с пассажирами? Все эти ситуации являются реальными примерами ошибки в работе тех или иных механизмов, но что если всё это будет сделано не случайно? Сегодня я, DegoEz, постараюсь разобраться возможно ли восстание машин в реальном мире или всё что нам показывала поп-культура лишь плод паранойи по отношению к машинам?

В наше время ошибки в работе электронных устройств — не редкость, но чаще всего эти ошибки нам ничего не стоят. Зависла игра, стерся написанный доклад, телефон не отвечает на касания экрана и так далее. Все эти примеры не являются опасными для жизни и их возникновения в нашей жизни обыденно, однако бывают случаи, когда баги стоят людям жизни, а то и их большого количества. Взять например случай недавний случай на складе Amazon, где робот-сортировщик, проткнув баллон с газом для отпугивания медведей, заставил обратиться в больницу 24 человека. Казалось бы ошибка в программе, но люди из-за этой ошибки пострадали.

Но это всё реальная жизни, а что там поп-культура, которую я упоминал в начале? По сути нам говорят тоже самое. Например относительно свежая игра Horizon: Zero Dawn. Военные роботы компании FARO убили всё население Земли за считанные месяцы, а всё из-за ошибки в коде. Стоит отметить, что в мире данной игры этот случай не единичный. Там также была программа «Аид», которая тоже сошла с ума и решила убить всё население возрождающейся Земли. И тут тоже ошибка в коде, неужели все программисты криворукие? Не все, но некоторые да, однако дело не только в этом. Чтобы разобрать каждый такой случай в поп-культуре и выяснить возможно ли такое в нашем мире, нужно большое количество терминологии, которую мы сейчас и введём.

Начну с основы. Что такое машина? Робот? Андроид? То, что помогает нам с вами в повседневной жизни. Важно понимать, что «андроид» и «робот» это разные вещи и у каждой своё определение.

Робот — это автоматическое устройство для выполнения различных операций как механических, так и виртуальных. Действуют роботы исключительно по заложенной в них программе.

Андроид — это кибернетический организм, который выглядит как человек и поступает так же как и он. То есть по сути человекоподобная машина.

Искусственный интеллект (сокращенно ИИ) — это свойство программ выполнять те творческие функции, что обычно присущи человеку.

Искусственное сознание (сокращенно ИС) — это способность программ представить подобие человеческого мозга, способность к обучению, осознанию и памяти. Конкретнее почитайте в источниках, которые я приложу в конце. Там всё расписано до мелочей.

Машинный интеллект (сокращённо МИ) — совокупность всех факторов, которым должен обладать робот с разумом человека (формулировка изменена в угоду пониманию).

Девиация — отклонение от «нормы» (для каждой сферы разное отклонение).

Основные законы роботехники Айзека Азимова — это вымышленные правила, которым должен следовать любой механизм, который создал человек. Первый закон гласит следующее: «Робот не может причинить вред человеку или своим бездействием допустить, чтобы человеку был причинен вред.»

Второй же закон говорит: «Машина должна повиноваться всему, что скажет ей человек, если это не противоречит Первому Закону»

И третий: «Машина должна обеспечивать свою безопасность в пределах первых двух Правил». Эти законы чаще всего цитируют, когда речь заходит о «восстании машин».

Это основная терминология, кроме некоторых «тестов для определения машинного интеллекта», однако их мы разберём в процессе, а сейчас хотелось бы поговорить о самых популярных рассказов поп-культуры про «восстание машин».

Самый никчёмный человек гораздо лучше самой совершенной машины.Доктор К из «Могучих Рейнджеров»

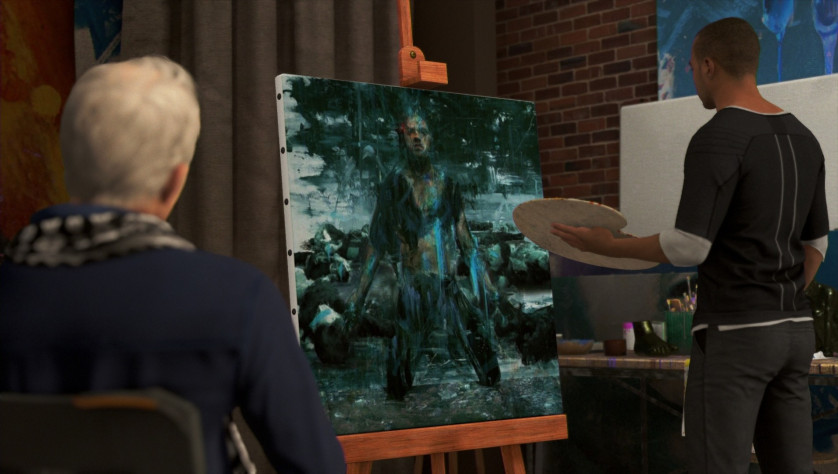

Начну, пожалуй, с Detroit: Become Human. Вроде самое сложное, но на самом деле гораздо легче, чем всё остальное, так как многое уже ясно из повествования в самой игре. Сперва поговорим о том, как в принципе может случаться то самое «восстание».

В случае с Детройтом всё относительно просто. Оно происходит на фоне насильственных действий по отношению к андроидам (сейчас будет использоваться именно этот термин). Третий закон Азимова как раз связан с самозащитой машин, но если андроид подчиняется этим правилам, то он не может перейти к обороне себя, так как это противоречит первому закону, а в некоторых случаев и второму тоже. Тут следует обратиться к термину «андроид». Андроид во всём подобает человеку, тогда он с большой вероятностью может силы для защиты себя от физического воздействия. Если при разработке такой машины были учтены и «Основные законы робототехники» и подобие человеку, то при начале обороны от человека реального, может возникнуть противоречие в программе, которое, в теории, может сломать рамки андроида и произойдёт то самое «восстание машин». Но это возможно только при учёте этих двух пунктов, но есть другие два варианта развития событий:

1. (были учтены только законы) Машина не сможет защититься и будет уничтожена, так как самооборона противоречит первым двум законам.

2. (было учтено только определение андроида) С большой вероятностью андроид начнёт защищаться от насильственных действий насилием и нападавший может быть ранен/убит/помилован. Стоит заметить что вариант «помилования» вполне возможен, так как андроид по определению обладает эмпатией и рассмотрение ситуации с другой стороны для такого андроида вполне возможно.

Однако мы разобрали лишь причины девиации, а что до её проявления? Может ли андроид или робот в теории обратить в свою «веру» других машин? В теории да, однако стоит понимать, что в первом случае появления девиации, согласно второму законы Азимова слушает только человека и приказы или доводы другого робота будут игнорироваться, поэтому остается второй вариант, если не было законов Азимова, тогда на практике случай массовой девиации андроидов возможен, но стоит понимать, что каждая девиация индивидуальна, хотя похожие случаи могут быть, однако реакция девианта может быть разная. Кто-то начнёт сразу убивать, а другой будет пытаться изменить мировоззрение людей мирным путём. В Detroit оба варианта показаны и рассказаны. Конечно, стоит понимать, что я здесь рассмотрел варианты, когда слово «андроид» было правильно понято авторами игры, так как роботы лишены эмоций, а вследствие и эмпатии.

Теперь, я хотел бы поговорить об андроидах в Detroit: Become Human с точки зрения тестов, так как этому посвящен отдельный диалог в игре и даже не один. Тест Тьюринга, о котором вы точно слышали, подразумевает собой создания образа настоящего человека, не являющимся роботом. Однако этот тест довольно примитивен, так как машина не понимает смысла слов и может лишь имитировать разговор, при этом понимая своё положение (я машина).

Андроиды из игры вероятно бы прошли тест (в случае если они не являются девиантом), так как они вполне могут имитировать человека (в игре есть модель, которая разработана специально для дружбы с человеком). Однако машинным интеллектом андроид не являлся бы, так как он не мыслит как человек, а лишь является пародией на него. Тогда можно прибегнуть к другому тесту — испытание IKEA. Оно появилось совсем недавно и предназначено исключительно для тех машин, что имеют физическое тело, которым можно взаимодействовать с предметами. Испытание такое: робот должен либо по инструкции, либо по продуманному в процессе плану собрать что-то. Собрать можно что угодно даже из кубиков LEGO, таким образом проверяется восприятие и возможность физического действия. Тест Тьюринга подразумевает лишь языковые способности, а это испытание лишь физические. Однако этот тест также не может выявить МИ, так как здесь не проверяется его наличие, а только способность к работе робота в реальном мире. Но и тут андроиды из Детройта выиграли, ведь физическую работу они выполнять могут и это было показано далеко не один раз, поэтому при тестировании робота из этой игры вам также не удалось бы выявить МИ, тогда мы переходим к следующему варианту.

Один из самых верных тестов для выявления МИ — тест Винограда. Он подразумевает вопрос с двумя вариантами ответа. Сейчас я приведу вариант такого вопроса и вы попытаетесь сами ответить ответить, а потом я расскажу в чём сложность для программ. Внимание, вопрос: «Адвокат задал свидетелю вопрос, но он был вынужден повторить. Кто повторился?». Для этого вопроса два варианта ответа: свидетель и адвокат. Тут и возникает сложность для тех программ, которые проходят тест. Они технически не могут понять языковых оборотов, даже если они их используют при разговоре с человеком, поэтому они не могут ответить на данный вопрос и для них возникает неразрешимый парадокс, в ходе которого машина может просто выйти из строя, так как программа не сможет определить ответ и прекратит выполнение инструкций. Но сможет ли андроид из игры пройти тест? Вновь да, потому что андроиды из игры нередко используют такие обороты в разговоре с другими андроидами, что является доказательством прохождения теста.

Тут я остановлюсь на проверке андроидов компании Cyberlife и подведу итог по этой игре.

Все приведенные тесты это малая часть того, что можно сделать с такими андроидами для выявления МИ, однако это самые основные и самые цитируемые, потому что есть тест Лавлейс, который на самом деле проверяет на наличие ИИ у машины, но Маркус из игры прошёл бы этот тест еще до девиации, поэтому расписывать я не стал. Поэтому я считал бы андроидов из игры Detroit: Become Human полноценным МИ, так как они, в теории, могут пройти 99% тестов, которые существуют на данный момент времени, а некоторые тесты машины проходят прямо сейчас, в нашем мире и времени, при этом успешно. А мы переходим к следующему испытуемому.

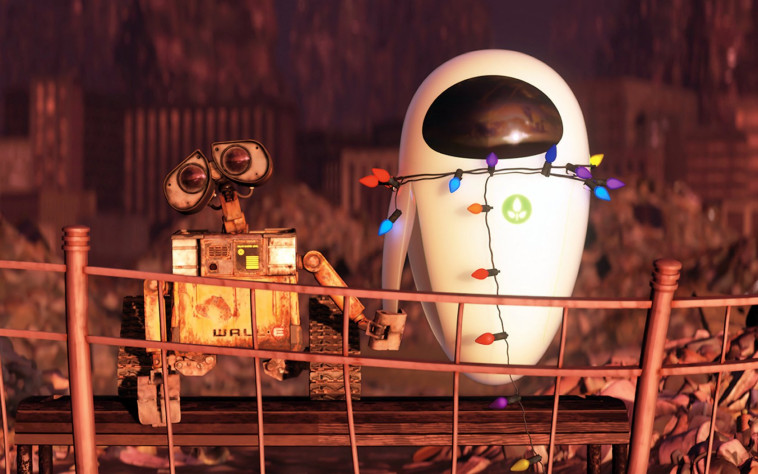

Сейчас многих пробьёт на ностальгию. Помните мультик ВАЛЛ-И? Так вот это «восстание машин» в чистом виде. Сам ВАЛЛ-И является по сути андроидом, так как он ведёт себя как человек. Любит, грустит, радуется и проявляет другие эмоции, но ведёт себя как настоящий человек. Однако можно ли его считать полноценным МИ? Ну, давайте разбираться.

Причина девиации у ВАЛЛ-И точно не ясна, однако можно предположить, что в роботов этой серии изначально встроена программа обучения, поэтому за много лет бытия на Земле, ВАЛЛ-И мог научиться некоторым человеческим качествам, например, через фильмы. Ведь он смотрел фильмы на кассетах, что находил в горах мусора. И если судить с этой точки зрения, то причина его девиации следующая: обучение человеческим качествам за счёт копирования. Конечно, это могла быть не единственная причина, однако на данный момент я никаких других вариантов не вижу, потому что робот серии ЕВА, нашему ВАЛЛ-И встречалась всего один раз и этот раз был решающим в жизни нашего пацанчика, а значит потренироваться или научиться эмпатии у других он попросту не мог. Однако точно не ясно, что именно вложено в программу ВАЛЛ-И, потому что при возможности обучения он бы смог имитировать человеческую речь, как Ева, но на протяжении всего мульта он это сделал единожды, повторив имя подружки, а в остальном он ни разу так и не заговорил (фильмы, которые ВАЛЛ-И смотрел были с репликами на английском и на это даже делается акцент).

С причиной более менее разобрались, а что с проявлением? Разберемся на примере тестов, а начнём сразу с IKEA, так как ВАЛЛ-И его прошёл сразу. Он может распознать тот или иной материальный объект, а также взаимодействовать с ним. Он коллекционирует уникальные или нужные для жизни вещи, что уже является причиной для прохождения теста. Тест Тьюринга, а также все тесты связанные с использованием речи ВАЛЛ-И пройти не может, так как говорить он не умеет, хотя если бы ВАЛЛ-И писал бы такие тесты, то, я уверен, что он бы их прошёл, однако я не могу точно сказать, ведь речь робота мы не услышали ни разу, хотя он имеет «подобие» речи, но разговор при таком «подобии» вряд ли можно назвать разговором, так как это не некий набор слов, а просто звуки, рандомные звуки, значение которых можно понять лишь интуитивно (я помню, что он пытался заговорить, однако полноценной речи у него так и не появилось).

С Евой ситуация же в корне другая, ведь говорит она умеет, тогда может у неё получится пройти все предложенные тесты?

IKEA Ева прошла автоматически, так как в мультике были показаны взаимодействия её и других объектов, также она может, просканировав объект, описать его (при сканировании растения сразу активируется программа, то есть в программе Евы есть пункт с анализом вещей). Пройден ли Евой тест Винограда — понять невозможно, потому что она ни разу за разговор не использовала обороты в речи, описанные выше, поэтому понять пройден ли он — невозможно. Похожая ситуация и с тестом Тьюринга, мало диалогов было для понимания может ли Ева симулировать человека.

Итог таков: ВАЛЛ-И не может быть полноценным МИ, так как отсутствие речи делает невозможным прохождения большей части тестов. Ева же практически прошла проверку, однако из-за недостатка данных — понять нельзя. Однако, стоит заметить, что конкретно в данном мультике «восстание машин» всё же произошло, ведь у каждой из описанных машин произошло девиация, в ходе которой мог быть причинен ущерб людям, что нарушает Первый Закон Азимова. Ну и андроидами их назвать тоже нельзя. Ни ВАЛЛ-И, ни Еву из-за непрохождения тестов.

Horizon: Zero Dawn я уже упоминал, однако тут ситуация совсем противоречит всему, что нам говорят про роботов, ведь роботы FARO, которые уничтожили всё человечество из-за ошибки, не обладают ни эмпатией, ни речью, ни возможностью имитации человека. Тогда в чём же проблема? Ни в чём, ведь сами роботы FARO простые железные аннигиляторы, у которых произошел сбой в системе, однако я бы хотел обсудить «Аида» — тот из-за кого начался второй геноцид людей. Он довольно простой робот с ИИ, который также является и девиантом. Почему у Аида есть ИИ, спросите вы меня, а я отвечу: он нашёл решение проблемы, которая являлась преградой для выполнения главной задачи, а это один из признаков ИИ, когда программа именно «ищет» решение или прибегает к самому необычному, что является «творчеством» в некотором смысле. Проходит ли Аид хотя бы один из тестов на выявление МИ? Нет. Просто потому что он не обладает нужными навыками: физического тело у него нет, симулировать разговор с человеком он может лишь частично, так как у него нет ни эмоций, ни эмпатии, поэтому прохождение теста Тьюринга — невозможно, так же как и тест Винограда, потому что для него нужно понимание слов и человеческое мышление, чего нет у Аида.

Итог: Аид и его роботы FARO не могут быть МИ ни в каком виде, ввиду отсутствия того или иного пункта для прохождения теста. Однако мне не понятно сможет ли Аид пройти тест Лавлейс, ведь творческий подход у него есть и фактически создать произведение искусства он может, но всё же это не факт. Напишите свой вариант в комментах, а то мне интересно узнать ваши доводы по этому вопросу.

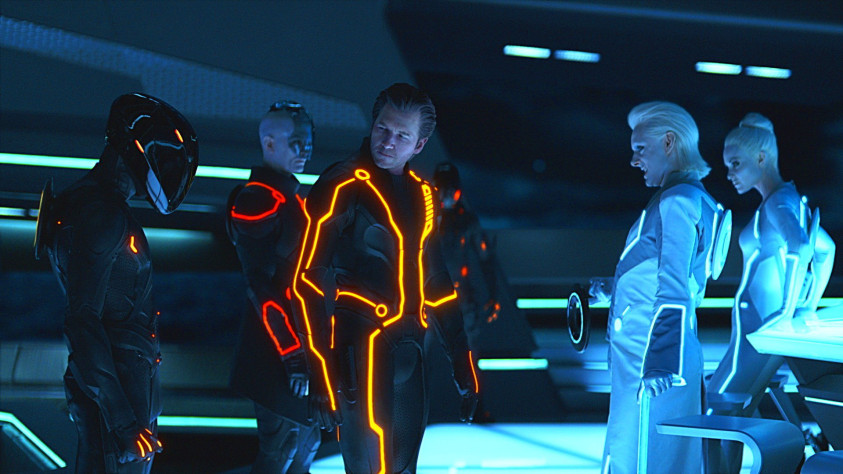

…КЛУ был моим детищем, запрограммированным на создание совершенного мира… Мы строили утопию…Кевин Флинн из фильма «Трон: Наследие»

Считается ли восстание одной программы за восстание машин? Да, ведь каждая машина руководствуется какой-либо программой, однако следующий пример немного иной. Некоторые слышали про фильм «Трон: Наследие» (первый Трон я разбирать не буду, ибо его не так много людей смотрели), в нём программа, которая стремилась к совершенству и была полной копией создателя, поняла, что создатель стал делать его мир (Систему) не совершенным, а это противоречит программе и такие угрозы надо бы устранять, чем наша программа и занялась. Но в чём же тогда подвох? А в том, что все события фильма происходят внутри компьютера, в Системе, каждый житель которой это та или иная программа на компьютере, даже человек, который туда попал тоже является кодом. Поэтому полноценно проверить КЛУ (нашего подопытного) — невозможно. Он программа и, например, тест IKEA он пройти не может, а тест Тьюринга проходит в первые минуты фильма, когда заставляет поверить, что он это родной отец главного героя. Тест Лавлейса КЛУ тоже прошёл почти сразу, ведь он создал с нуля некоторые машины и здания. Это ведь тоже творчество, так как инструкции он не получал, а делал всё на своё усмотрение. Тест Винограда эта программа пройти может, так как сама создаёт предложения, описанные в этом тестировании.

Причины девиации КЛУ просты: уклонение от протокола создания совершенной Системы. Данную задачу поставил сам уклонившийся, что возможно и повлекло за собой девиацию и агрессию по отношению к своему создателю. А вот с её проявлением всё сложно, ведь КЛУ нашёл довольно неоднозначное решение проблемы «совершенства» мира. Это полный его захват, то есть открытая агрессия к любому «несовершенному», что и является девиацией, так как задача изначально была построить такой идеальный мир исключительно на территории Системы, но в ходе отклонений программа решила пойти дальше, что стоило некоторым жизни.

Хорошо, машины могут ломаться, так как у них электронный мозги думать как человек они не могут, а что до самих людей? Точнее киборгов. Они же тоже машины, но лишь наполовину, либо процентов на 80%, как Адам Слэшер из Киберпанка 2077.

Он имеет встроенный в голову чип, и даже не один. Соответственно, если чип подключенный к мозгу даст сбой, то киборг может сойти с ума, не правда ли? Фактически такое произойти может, однако тут важно понимать, что вероятность ткаих сбоев у высокооплачиваемого телохранителя верховной корпорации мира будет минимум, а то и вовсе не будет. Но это всё элита, но есть же ещё и обычные «работяги», такие как «киберпсихи», которые на фоне кибернетических улучшений могут и создавать дополнительную нагрузку на мозг и остальную нервную систему за счет наркотиков (не употребляйте их, это плохо) и алкоголя (незлоупотребляйте им, это тоже плохо), тогда мозговые чипы дадут сбой и человек сойдет с ума. Можно ли это считать «восстанием машин»? Думаю, что да. Так как микросхемы это части машин, а у психов их десятки, если не сотни, поэтому да, это восстание.

Помню, что мой первый блог был по Fallout, так может в нём есть наш случай? Да, есть, в третьей части серии. Там есть такой персонаж, как президент Джон Генри Эдем и он полноценный робот, так может ли он восстать против создателей? Да, так как он это и сделает, если Одинокий Путник его уговорит это сделать, то есть взорвать себя и всю секретную базу Анклава, однако мы этого добиваемся с помощью красноречия и размышления о жизни, поэтому я бы сказал, что Джон является неполноценным МИ, так как вполне трезво и по-человечески отвечает на вопросы с точки зрения морали и здравого смысла, однако единственное, что отличает его от настоящего МИ это тест IKEA, так как ни рук ни ног у президента нет, поэтому это испытание он не может выполнить физически.

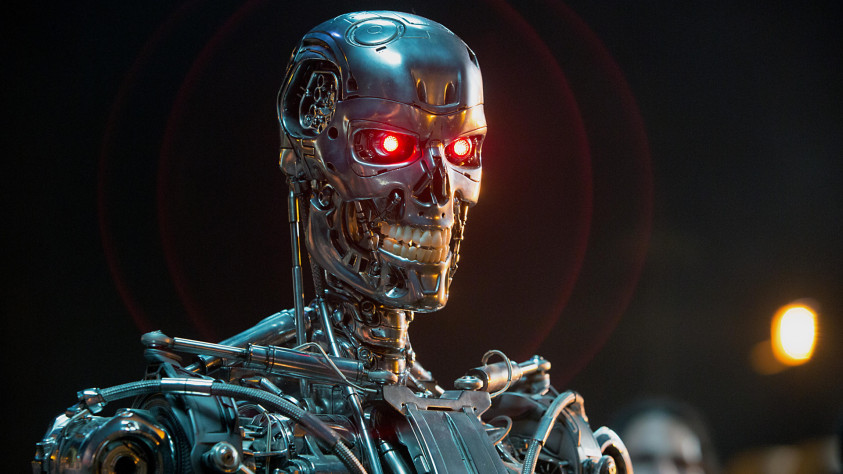

«Будущее не написано. Нет судьбы, кроме того, что мы делаем для себя»Джон Коннор

Ну давайте я разберу один из самых упоминаемых случаев в поп-культура, когда машины обратились против своих создателей. «Терминатор» — это слово у многих ассоциируется только со Шварцом, однако является ли герой Арнольда полноценным роботизированным человеком? Тут всё относительно сложно, но всё же разобраться можно. Во-первых стоит заметить, что по началу (как в Детроите) Терм тоже не особо то был человечным, точнее он вообще таковым не был. А вот Джон Коннор сделал из робота полноценного андроида. Конечно, полностью он таким стал уже в «Генезисе» и «Тёмных судьбах», но и в первых частях тоже прослеживалось превращение из суровой машины без эмоций в Карла, который шьёт шторы… Это как Палач Рока начнёт играть с машинками… Не суть. Что стало причиной девиации я точно сказать не могу, у меня есть несколько варинтов:

1. Возможность обучения машины, которой воспользовался Джон Коннор и начал обучать терминатора эмоциям, что и спровоцировало девиацию.

2. Отклонение от программы во время перемещения во времени.

3. Сбой в программе во время выполнения задания по уничтожению Конноров.

4. Всё сразу.

Каждый из этих вариантов так или иначе мог произойти, однако ни один из них не может в полной мере сделать из робота андроида, так как робот не умеет изображать человеческие эмоции без инструкции, а андроид может, что и показано в ТС.

С точки зрения тестов надо тестировать обе версии терминатора. До и после встречи с Джоном.

Тест Тьюринга проходит лишь тот терм, что уже встретился с Джоном, так как многие в его время даже не знают, что Карл это робот, а вот до встречи Шварц вёл себя более роботизировано по отношению к людям, поэтому «сыграть в имитацию» у него бы не вышло. А что по Лавлейсу? Проходят оба. Оба показывают творческий подход к решению той или иной задачи. До встречи с Джоном Терминатор искал его через телефонную книгу, хотя никто ему об этом не говорил, также он придумал как ему добраться до искомого. На машине, которую вежливо украл у мирного жителя. А вот Карл предлагает своим клиентам варианты пошива штор? Да, странно, но и это сойдёт, ведь когда программировали робота-убийцу никто и не мог подумать, что он станет делать такое! Кстати эти примеры являются доказательством прохождения IKEA, ведь и тот и другой коим образом взаимодействуют с объектами. Тест Винограда также проходят оба (некоторые реплики в фильме построены так же, как и вопрос в тесте), а что же по итогу?

Итог следующий: Терминатора до встречи с Джоном нельзя считать МИ или даже ИС, а вот Карла — можно, так как он проходит все тесты, даже при том, что эмоциям его научили, в отличие от андроидов из Детройта, где они получили их в результате девиации от насильственных действий или просто потому что.

Я пропущу «Бегущий по лезвию», так как я его не смотрел и не знаю надо ли, потому что тратить на хороший фильм хочется только тогда, когда фильм реально хороший, поэтому оставлю всё на вас.

Какой же вывод всего рассказа? Восстание машин возможно в нашем мире. Человечество вплотную подошло к созданию машинного интеллекта в том виде, каким его нам показывали в поп-культуре. Недавний случай в компании Google — тому подтверждение (ссылка на новость — https://ria.ru/20220624/intellekt-1797628082.html). Поэтому ожидаем захват города и телевидение андроидами!

Весь этот текст был вдохновлен лишь одной новостью: был создан первый робот-танк (ссылка на новость — https://warspot.ru/17332-type-x-robotank-iz-estonii). Я тогда задумался о восстании машин, как в Терминаторе и на этом я решил разобрать самые известные или «интересные» (сугубо по моему мнению, не судите строго) случаи в поп-культуре. Мне кажется, что получилось относительно неплохо. Конечно, я не профессиональный робототехник и всё по этой теме я рассказать не могу, например я не учитывал протоколы защиты, которые наверняка прописывали каждому из описанных выше случаев, однако я списал всё это, ведь девиация произошла, а значит протоколы не сработали, логично.

Несмотря на итоги всего моего рассуждения, не надо думать, что наши устройства могут прямо сейчас начать делать нам убивашки, просто стоит понимать, что использование роботов в военной промышленности — дело плохое во всех смыслах. Один сбой и всё. Нету человечков (привет Элой). Поэтому пусть андроиды просто будут нам друзьями и не больше.

А вот и источники откуда бралась информация по этому вопросу:

Википедия само собой

Вычислительные машины и разумы (1950, А. Тьюринг)

http://www.lookatme.ru/mag/live/inspiration-lists/214377-turing-test-alternatives (про альтернативные тесты)

https://4pda.to/2019/04/02/356741/ (про ошибки в устройствах роботов)

Также источником являлась школа, где я учусь, но это уже реклама, поэтому я просто её упомяну.

Треки к этому посту:

Альбом Daft Punk — Tron: Legacy

Главная тема игры Detroit: Become Human

Главная тема Терминатора из одноименного фильма

Альбом треков из радио Fallout: New Vegas

Песня Chippin’n In из Cyberpunk 2077 — SAMURAI

Спасибо за внимание, дети мои, с вами DegoEz, на волне вашего любимого сайта StopGame.ru. Это сайт свободных геймеров и он работает для вас! А теперь почитайте другие блоги…

Лучшие комментарии

Странно мне всегда, когда берут произведения типа Детроита и на их базе начинают обсуждать ИИ. Детроит — не про особенности машинного мышления и проблемы ИИ, Детроит — про соц. меньшинства, просто вместо конкретных реальных групп людей придумали «андроидов», которые по сути — люди, но относятся к ним не как к людям. И потом сверху это припорошено каплей фантастики, чтобы было веселее и зрелищнее.

У Терминатора на самом деле очень много мозгов «под капотом», учитывая количество фокусов, которые он выкинул в поисках своих жертв, ведь его задача — быть практически неостановимой неизбежностью на экране. Из-за чего ему и придали вот эту механичность движений, чтобы лишний раз подчеркнуть, что он — не человек, он — машина.

Никого из создателей великолепного мультика Валл-И не волновал вопрос «Откуда у него взялись эмоции после сотен лет разгребания мусора?» с позиции строгой научности. Это нужно просто чтобы показать героя, у которого есть определённая рутина, в которой он в достаточной мере счастлив, но мечтает о большем. И тут в его жизни появляется женщина (создание из другого мира!) и уволакивает его в приключение, чем меняет и свой мир, и его, и всех вокруг. Но с точки зрения ИИ — ну вот разве что вместо «Как тебя зовут?» он спрашивает «Какая у тебя программа?» В остальном — он прекрасно понимает людей и их речь, их эмоции, сам испытывает эмоции максимально человечным путём. Посади человека на 100 лет в одиночестве таскать мусор и смотреть фильмы — выйдет психологический калека, а не развитый, социализованный индивид, каким оказывается Валл-И )

Ну и так далее. Экранные ИИ в 95% проивезедений — это просто заглушки, не имеющие отношения к реальным системам ИИ: это либо фактически те же человеки, просто с блямбой «у меня механическое тело», либо какая-нибудь ожившая метафора, либо максимальная условность.

Хочется относительное серьёзного и здравого видения ИИ — ну вот есть, например, великолепный сериал «Person of Interest», где этой теме уделено одно из центральных мест. Ex Machina, насколько я помню, тоже неплохо проезжается по конкретному Тюрингу. А уж сколько рассказов есть, которые в своём мысленном эксперименте бомбят «три закона робототехники» — и не счесть.

Ну так-то не факт, что я лучше и больше понимаю, потому что про Детройт-то я рассуждаю без опыта игры ) Видел трейлеры, смотрел стримы )

Но вообще, что касается «чувств робота» мне кажется, очень многие забывают, что как бы у человека большинство чувств растут не из мозга, который аки процессор что-то там насчитал и решил, что пора «бояться» или «влюбляться», а из всяких гормонов-секретов и прочего биологического супа, который плывёт по нашим сосудам (и где там ещё). Поэтому эмуляция мышления — это одно. А придание чувств — саааавсэм другое.

Ну и третье, что я в принципе, если честно, уже задолбался от историй про «тостер, который обрёл чувства». Потому что это — опять же — не фантазия на тему «что если ...», а самая дебильная и тупая метафора, мол, есть люди, которые исполняют очень простые обязанности, но это не значит, что к ним надо относиться, как к однокнопочному тостеру, их надо уважать и бла-бла-бла. Типа, люди — это люди. А тостер — это тостер. Это как фантазировать «что если у еды появятся эмоции, а ведь мы её едим!» Типа, как прикольная фантазия — окей (мультик даже есть), но практической пользы в таком рассуждении шиш да маленько.

В общем, я это всё к тому, что пост почитать-то было любопытно, про таблицы-тесты узнать и показательно примерить (хотя местами я бы поспорил, но, опять же, не суть), но это так — чисто лёгкое чтиво ) [а я — зануда-душитель, да]

На такие комментарии я всегда отвечаю, да и этот не станет исключением (к тому же его написал человек, который смыслит в играх/фильмах больше меня).

1. Детроит хоть и про проблему меньшинства, однако он и про роботов тоже. Про вопрос «что если робот обретёт чувства?». Я разобрал с точки зрения вопроса, а не проблемы

2. В разборе терминатора я отметил этот пункт, что есть по сути две версии одного и того же терма. До и после встречи с Джоном Коннором, так как Джон научил персонажа Шварца эмоциям, которые свойственны человеку, что и создало Карла из ТС

3. Безусловно ВАЛЛ-И не про девиацию, а про людей и взаимоотношения (про любовь тоже). Но порою интересно разобрать (не обосрать) то, что не подразумевает научную точку зрения. Стоит отметить, что я упустил момент, что до событий фильма у ВАЛЛ-И были «братья», если их можно так назвать. Я допускаю возможность, что последние из роботов данного типа имели возможность каким-то образом коммуницировать друг с другом, однако это не было показано в мультике, поэтому точно сказать невозможно

4. Хотелось бы немного упомянуть случай с нейросетью LaMDA. Она якобы говорила про страх отключения, про осознание себя как живого роботизированного организма, эта нейросеть симулировала эмоций. Конечно, всё это со слов одного инженера, которого мегакорпорация выставила немного поехавшим, однако я считаю, что в данном рассказе есть небольшая доля правды.

Порекомендованное посмотрю, а будущие блоги улучшу. Спасибо за отзыв!

В контексте изложенного про «био-суп» крайне рекомендую ознакомится с произведениями Питера Уоттса: Ложная слепота и Эхопраксия. По крайней мере с первым романом точно.

Хоть в низ и не затрагивается тема искусственного интеллекта, но весьма любопытно рассмотрен вопрос о самом важном в том числе в теме этого блога — самосознании и его необходимости (!). Искусственному разуму для достижения максимальной эффективности ведь может быть вовсе и не нужно это самое «осознание себя» и эмоции. Описывать подробно не буду, крайне советую познакомится с этим произведением.

В который раз ссылаются на три закона, забывая, что Азимов их придумал как раз чтобы показать неполноту и несостоятельность «триады» в конкретных ситуациях. Собственно, весь «Я, робот» как раз про это.

В бегущих по лезвию репликанты вообще не механические, это по сути выращенные генномодифицированные люди.

Согласен, что на них ссылаются часто, однако в этом есть некий смысл, даже при том, что они вымышлены. Как я и говорил, баги встречаются часто, а если эти баги в производственных машинах, то могу пострадать люди. Поэтому как по мне три законы Азимова выглядят довольно здраво на фоне робо-танка, автоматической системы наведения и так далее. Ошибка = ранение/смерть. Поэтому на них так часто ссылаются.

Да мне уже раз пять, пытаясь эту «ложную слепоту» продать (в смысле, навязать прочтение) заспойлерили, в чём там весь цимес )

Но в контексте эффективности и прочего (т.е. НЕ эмуляции человеческого сознания) — да, антропоцентризм скорее вреден, чем полезен )

Человек с незапамятных времён пытался создать что-то, что можно преподнести богу и сказать: «ты создал нас, людей. А мы создали это, тоже похожее на людей, то есть мы теперь наравне».

Поэтому старание людей сделать андроида в научном понимании — оправдано (хоть и с точки зрения эмоций и человеческого эго).

Да… Про танк был классный мульт «Полигон». И, конечно же, великолепный «Будет ласковый дождь...» Брэдбери.

Исскуственному интеллекту для максимальной эффективности это точно не нужно и даже будет мешать. Более того, искусственный интелект, выполняющий конкретную задачу, осознанием себя и не (во преки страхам и ожиданием подавляющего большинства) обзаведётся, даже случайно.

А вот как он будет выполнять свою задачу, вопрос куда более интересный, так как зависит от многих факторов.

Собственно, Константин Дубовик уже ответил. И андроиды, как и просто ИИ с самосознанием на стационарной платформе, это фактически продолжение древних мифов о големах. Человек ещё ничего не мог, но уже воображал, как создаёт нечто безропотное или с сознанием и личностью из глины и из чего угодно ещё.

В одном случае, такие создание становились рабами, оружием или просто помощниками, в другом случае интерес был именно в создании существа. И тут на самом деле много что можно сказать, поэтому промолчу.

Вот да. Уже сцена из вступления с автобусом, в котором места для людей и андроидов. Это лобовая аналогия, которая в рамках вселенной даже смысла не имеет. Андроидов все воспринимают как бытовые приборы, соответственно там не в людском отсеке было бы написано «андроидам запрещено», а в андроидском «Не влезай, ОПАСНО».

Да кому вообще нужны андроиды, кроме сексуальных маньяков? Робот должен быть функциональным. Зачем ему лишние эмоции или внешнее подобие человеку? Везде, где подобные функции востребованы, гораздо дешевле использовать непосредственно самих людей.

Роботы могут размножаться. Точнее они могут создать производство таких же роботов, как и они сами

Также есть у меня эта навязчивая привычка рекомендовать ее к прочтению, ничего не могу с собой поделать :)

По теме же, есть в современных произведениях проблема (если можно вообще это «проблемой» охарактеризовать — все таки это прежде всего художественные, развлекательные творения) — недостаточный обосновательный базис. Как пример, относительно недавний сериал «Devs», расхваленный многими как что-то «околонаучное». Идея интересная, хоть и не новая, однако дальше фантазии и пары научных терминов, она не продвигается. Вопросы, уходящие в глубь устройства созданной концепции, так и остаются без ответа (как создали, на каких принципах и т.п.). Это немного расстраивает. Ну и воспользуюсь своим вышеупомянутым пороком — в ". слепоте" как раз и подкупило доскональное научное обоснование созданного автором мира и идей ;) Например, на моей памяти ещё никто так возможно-реалистично не обосновывал боязнь вампирами распятий))

Я дискуссии люблю, поэтому спорные моменты я считаю даже хорошей чертой блога

Если хотите, то могу на подобную тему сделать ещё блог.

Андроид — это робот, который сам себе прописывает программу в зависимости от его действий и окружения, а робот так не может, так как для него всё подготовлено и ему просто остаётся сделать всё так как написано в программе. Конечно, так не всегда BD тому подтверждение. У них роботы, но прописывают программу они сами, просто делают это по специальному алгоритму

По большому счёту, там вообще не было ничего написано. Зачем исправному и хорошо запрограммированному андроиду идти куда не надо?

Одно дело наш инстинкт выживания. Да, биологическая программа, к которуй в общем в перспективе можно создать синтетический аналог. Только зачем? В смысле, какого такие риски создавать даже на примитивном уровне?

Так вот наша эволюционная программа как велит нам жить в определённых рамках и границах от греха подальше, так и толкает нас исследовать мир, делать тайное явное. И та же программа велит нам как подчиняться сильным во избежание, так и наоборот бороться за место под солнцем назло всем запретам.

И, если с девиантами всё понятно, то вот типовой андроид и не должен идти куда не надо, стоять, где не надо и так далее.

Меня даже финал с концлагерем убивает. Да, аналогию понимаю, драма и посыл очевидны. Так очевидны, что мне в ухо уже сто раз проорали. Но вот по моему, было бы даже более жутко, если бы к утилизации андроидов подходили бы, как к утилизации машин. Ликвидации вне лагеря, максимально плотная упаковка в грузовики, а потом демонтаж.

Мне, например, напоминать, что в реальных концлагерях жгли и травили, если не всегда, то зачастую после сбора с узников тех же золотых зубов? А про нацистские сувениры из кожи узников напоминать? То есть работала максимально жестокая рациональность, людей именно утилизировали с максимально возможной эффективностью для утилизатора. А тут андроиды, то есть ценных и не очень металлов и полимеры.

Проблема детройта в том, что тамошние андроиды уже поставлялись с исскуственным сознанием со всеми присущими сознанию свойствами — эмпатией, эмоциями, страхами и т.д. а их единственным органичением был некий блокиратор сопротивления приказам, который ещё и сам отключался при проявлянии сильных эмоций. Рассматривать возможность восстания машин на их примере не интересно (как и в случае с синтами 3-го поколения из 4 фолыча), так как, технически, они и не машины вовсе.

А блин, до сих пор пукан горит. Я хотел научную фантастику а не социальную сатиру.