Видео версия:

Съёмки - кадры из разных видеоигр и прочее:

- Cyberpunk 2077, новостных сайтов и других.

Музыка - различные треки:

- Suno AI - Minimal Ambient Tech Intelligent Electronica

- Suno AI - Abstract Cinematic Philosophical Underscore

- Suno AI - Neutral Analytical Tension

Текст: Евгений Губанов aka Kivlov

Читает: Евгений Губанов aka Kivlov

Монтаж: Евгений Губанов aka Kivlov

Текстовая версия:

Оглавление

Вступление

Назад к оглавлению

Приветствую, друзья! Под первой частью моего блога об этике применения ИИ в комментариях под его текстовой версией на СтопГейме разгорелись жаркие споры. И это не удивительно — тема действительно острая и актуальная.

Более того, меня даже упрекнули в том, что я якобы обхожу стороной самые неудобные аргументы против ИИ. Мол, говорю о частностях, но не затрагиваю по-настоящему болезненные и глобальные аспекты. Поэтому я решил продолжить разговор и разобрать те вопросы, которые в прошлый раз остались за кадром. Не потому что они «неудобные», а потому что лежат в плоскостях, куда более далёких от игровой индустрии. А в первой части я сознательно держал фокус на том, что ближе относится именно к играм.

Но раз уж эти вопросы закономерно возникли — давайте разберём и их. Поговорим о более глобальных сомнениях, страхах и противоречиях, связанных с ИИ.

Отдельно прозвучала претензия, что предыдущий блог получился скучным. И здесь я, честно говоря, не совсем понимаю, что с этим делать. Потому что спокойный анализ сложной темы — это почти всегда скучно. Как я уже отмечал в первой части блога, если отбросить эмоции, остаются нудные юридические детали, вопросы лицензий, регулирования, прозрачности, распределения ответственности и правил игры. Это всё же не формат ток-шоу.

Часто, авторы, освещающие эти темы, сразу же выбирают сторону, уходят в достаточно агрессивную риторику, устраивая настоящую драму. И это обычно хорошо заходит аудитории.

Конечно, гораздо веселее обострить тему, сразу же выбрать сторону и спровоцировать срач. Это быстро собирает внимание и лайки. Но проблема в том, что таким образом почти никакие серьёзные вопросы не решаются.

Поэтому давайте договоримся так — если кому-то такая сухая нейтральная информация покажется чрезмерно скучной — можете смело пропустить разделы с разбором аргументов про экологию, потребление энергии, экономику и использование ИИ во зло — переходите сразу к части про насильное навязывание ИИ, провоцирование конфликтов и фактор человечности — они вышли у меня эмоциональнее и жизненнее. Таймкоды будут в описании к видео и в закреплённом комменте.

А теперь продолжим разговор в том же ключе — спокойно, последовательно и без попытки упрощать сложные вещи до чёрно-белых схем. И пусть меня будут считать душным, но я считаю, что такой спокойный формат разбора острых тем тоже очень важен и нужен.

Аргумент № 7. ИИ гробит экологию!

Назад к оглавлению

Этика, безусловно, важна. Но если выйти за пределы вопросов авторского права и рынка и посмотреть шире — то что насчёт влияния ИИ на мир в других аспектах? Например, в экологическом. Ведь ИИ потребляет большое количество энергии.

Чтобы массово обеспечивать пользователей сервисами на базе нейросетей, строятся новые дата-центры, растёт нагрузка на инфраструктуру, увеличивается потребление электроэнергии. И надо быть честным — это не проходит бесследно.

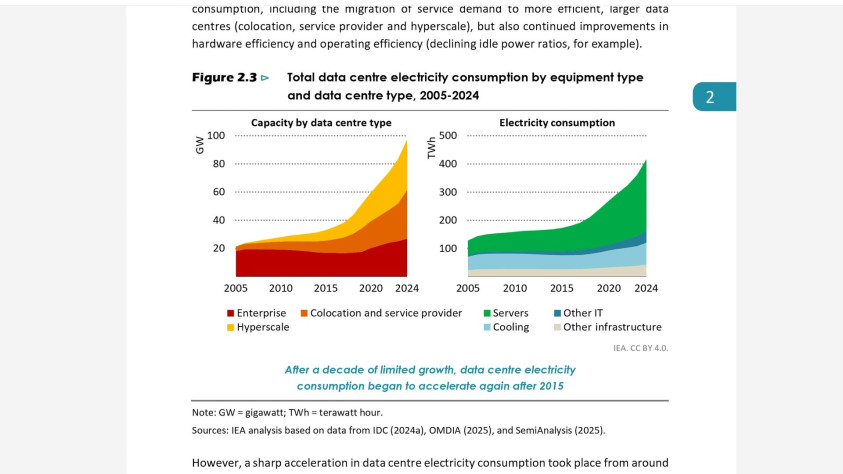

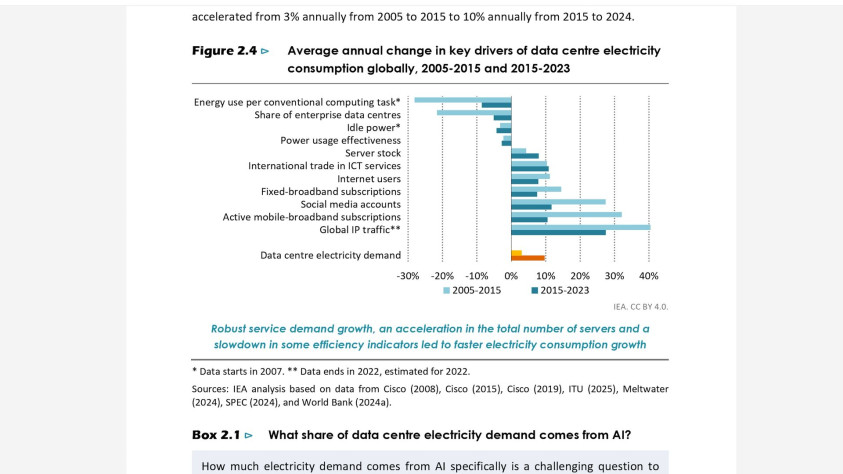

Так, по оценкам International Energy Agency в 2024 году одни только дата‑центры потребили около 415 ТВт·ч — это примерно 1,5% мировой электроэнергии [Источники]; в базовом сценарии потребление дата‑центров к 2030‑му может примерно удвоиться, и рост вычислений для ИИ называют одним из главных драйверов роста. И это довольно тревожная тенденция.

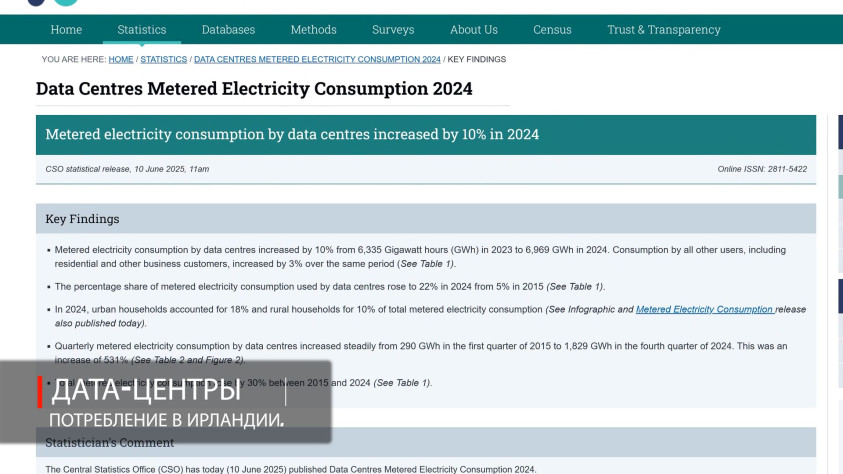

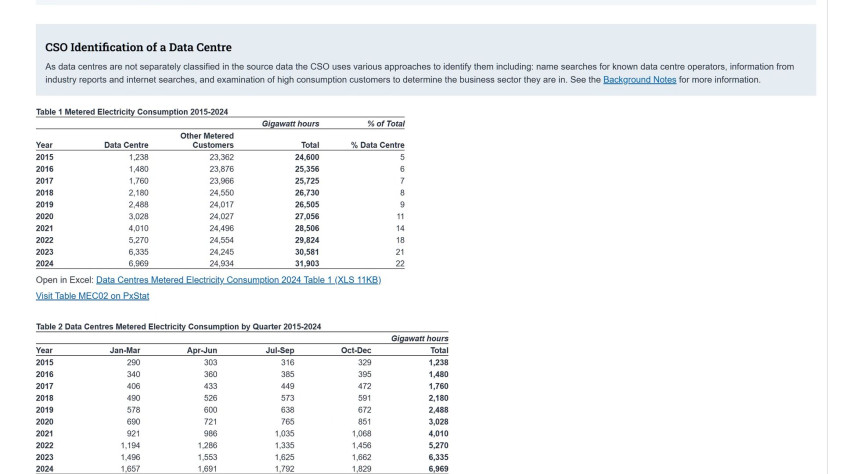

Например, в Ирландии дата‑центры заняли 22% учтённого потребления электроэнергии за 2024 год — и вокруг их расширения идут вполне серьёзные политические споры. [Источник]

И от этого не выйдет просто отмахнуться фразой «все наши технологии что-то потребляют». Да, энергопотребление дата-центров растёт, и ИИ в этом процессе играет заметную роль. Масштаб внедрения нейросетевых сервисов огромен, а их вычислительная природа требует серьёзных ресурсов. Игнорировать это — значит врать самим себе.

Но также нечестно будет и упрощать картину до формулы «ИИ разрушает экологию». Во-первых, ИИ — не единственный драйвер роста энергопотребления. Стриминговые сервисы, облачные вычисления, криптовалюты, Big Data, постоянная синхронизация умных устройств — всё это уже годами увеличивает нагрузку на инфраструктуру. ИИ встроился в этот тренд, но не породил его с нуля.

Во-вторых, важно различать этапы. Обучение крупных моделей действительно энергозатратно — это разовые, самые тяжёлые вычислительные процессы. Но повседневное использование (inference) на уровне единичного запроса менее ресурсоёмко, особенно по мере оптимизации моделей. Да, при достаточно массовом использовании суммарно ресурсов пока ещё требуется много. Но технологии квантования, сжатия (прунинг и дистилляция), специализированные ИИ-чипы, архитектурные улучшения — всё это постепенно снижает стоимость каждого запроса. Индустрия, как ни парадоксально, заинтересована в эффективности не меньше экологов, потому что затрачиваемая энергия — это реальные деньги.

Это не отменяет того, что проблема существует. Но она лежит не в плоскости существовании ИИ как такового, а в грамотном управлении и регулировании. Я считаю, что самая взвешенная и рациональная позиция здесь — не демонизировать технологию, а обсуждать условия её применения. Например, в сбалансированности масштаба — т. е. где проходит граница между реальной пользой и бессмысленной нагрузкой. Любая масштабная инфраструктура оставляет экологический след. Вопрос в том, как сделать технологическое развитие ответственным и соразмерным реальной ценности, которую оно даёт.

Ситуация с ИИ не просто так предельно накалила и поляризовала общество. И если жаркие споры вокруг ИИ чему-то и учат, так это тому, что простых ответов здесь нет. Нужно считать, сравнивать, оптимизировать и грамотно регулировать. И да — это в крайней степени скучно. Гораздо веселее подменять трудный разговор эмоциональной драмой с простыми и удобными лозунгами вроде «ИИ — зло!» и «Корпорации всё захватили!».

Аргумент № 8. ИИ гробит экономику!

Назад к оглавлению

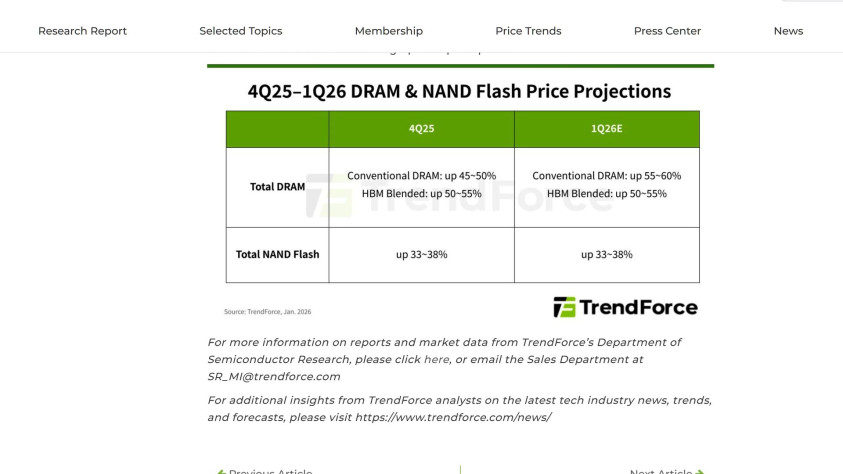

А что с экономикой? Это, пожалуй, одна из самых неприятных тем. Цены на комплектующие видят все. Сборка своего компьютера всё больше напоминает покупку автомобиля в кредит. Видеокарты уже давно стоят космических денег, но будто бы этого было мало — вслед за ними взлетели до небес и цены на оперативную память, и даже накопители. И на этом фоне легко напрашивается вывод: «Во всём виноват проклятый ИИ». Хотя, производители заранее предупреждали о росте цен на DRAM и NAND из‑за дефицита и спроса со стороны ИИ-сегмента.

Но здесь, как и в других аргументах, есть несколько слоёв проблемы.

Первый — дефицит и рост спроса на GPU. Это от части правда. Спрос на графические процессоры действительно резко вырос: причём производственные мощности в первую очередь поглощают корпоративные заказчики. Дата-центры и крупные AI-компании закупают огромные объёмы железа.

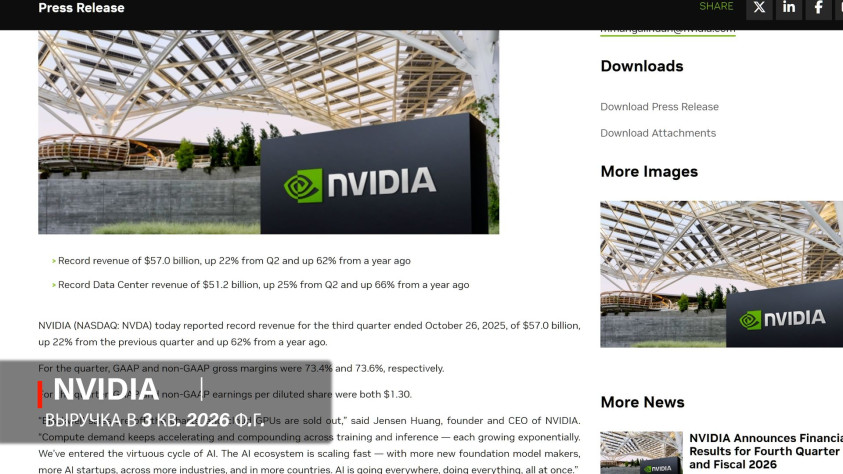

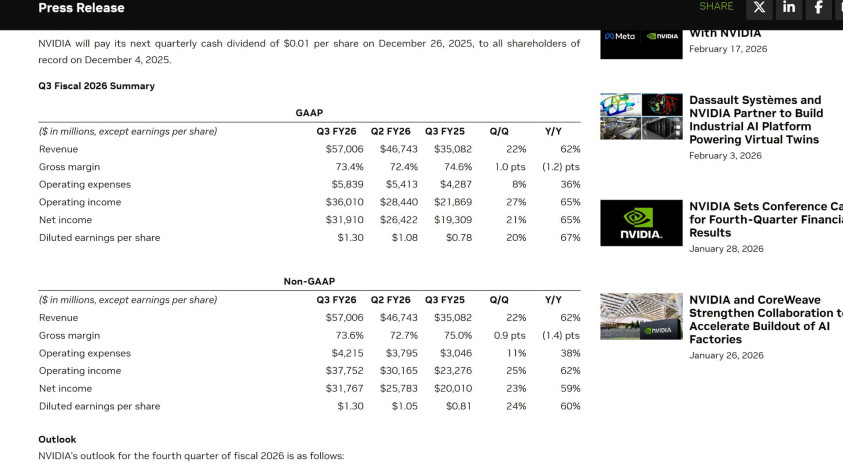

И это видно в цифрах поставщиков. Например, у Nvidia дата‑центровая выручка в 3 квартале 2026 финансового года выросла до рекордных значений и стала доминирующей частью бизнеса, а сама компания публично описывала спрос на AI‑ускорители как ситуацию «продаём всё, что успеваем произвести». [Источник]

Побочный эффект — дефицит и перекосы по всей цепочке комплектующих (особенно там, где рынок упирается в потребности AI‑сервисов). Так, в 2025–2026 обострились проблемы с поставками и ростом цен в сегменте оперативной памяти. Источник]

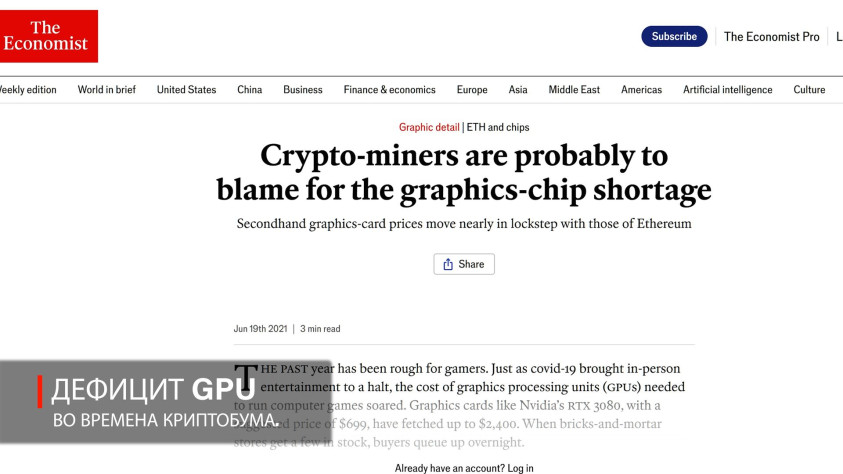

Рынок лихорадит, и обычный потребитель чувствует это в первую очередь. Конечно, проблемы провоцирует не только ИИ, но это тот самый новый фактор, на который сейчас легче всего списать «всеобщее подорожание». Но важно помнить: рынок железа исторически цикличен. Мы уже видели похожую ситуацию во время криптобума, когда майнеры массово скупали видеокарты, цены тоже резко росли, а геймеры оставались ни с чем из-за дефицита. Тогда тоже казалось, что новомодные технологии вроде блокчейна и NFT «гробят индустрию». Но через какое-то время после коррекции рынок восстановился, произошло перепроизводство, и цены упали. Источник]

Сейчас ситуация схожая, но не идентичная. ИИ действительно создаёт большой дополнительный спрос, но подорожание железа связано не только с ним. Мы имеем дело со сложным коктейлем причин. Отголоски ковидных логистических проблем (после которых компании увеличили закупки — в стратегический запас), геополитика, чиповая война между США и Китаем, расширение всех облачных сервисов в целом — всё наложилось друг на друга.

А тем временем рынку требуется всё больше вычислительных мощностей и новых дата-центров. Не стоит забывать про видео и стриминговые сервисы, значительный рост числа умных устройств (от датчиков умных домов до беспилотных автомобилей), требующих подключения к сети и обработки данных. А существует же ещё Big Data — компании в наше время собирают всё больше данных о своих клиентах, и их тоже надо где-то хранить и обрабатывать. Поэтому сваливать весь рост цен исключительно на ИИ — значит упрощать куда более сложную ситуацию до удобного виновника.

Отдельный нюанс — разговор о «пузыре ИИ». Огромные инвестиции, неочевидная монетизация, корпоративная гонка, страх безнадёжно «отстать от прогресса» — всё это действительно напоминает классическую фазу технологической переоценки. История с доткомами здесь часто вспоминается не случайно. Любая новая технологическая волна проходит через этап перегрева, когда ожидания опережают реальность. Коррекция и стабилизация обязательно произойдёт, но вопрос в том, когда и насколько болезненной она окажется.

Здесь интересно будет провести некоторые параллели с майнингом. Похоже многое: резкий скачок спроса на GPU, спекулятивная волна, ощущение «новой экономики», FOMO (боязнь пропустить интересное), перекос рынка в сторону корпоративных или спекулятивных игроков. Но есть и принципиальное отличие. Майнинг — это относительно узкое применение, привязанное к поддержке конкретной модели блокчейна. ИИ — технология гораздо шире. Автоматизация, аналитика, медицина, образование, инструменты разработки, игры — спектр применения несоизмеримо больше. Даже если инвестиционная волна частично схлопнется, инфраструктура и прикладные решения никуда не исчезнут.

И это ключевой момент. Да, рынок может перегреться. Да, цены могут быть завышены из-за ажиотажа. Да, инвесторы могут разочароваться в темпах монетизации. Но это не финансовая пирамида — т. к. сама технология не зациклена исключительно на спекулятивном спросе на железо. Даже при «схлопывании пузыря» по аналогии с доткомами останется реальная инфраструктура, реальные инструменты и реальные сценарии применения.

Сейчас мы имеем дело с фазой ускоренного роста и перераспределения ресурсов, которая всегда сопровождается перекосами. Но в итоге рынок адаптируется к новой технологической волне, и устойчивый баланс между ожиданиями и реальностью будет установлен.

Аргумент № 9. ИИ используют во зло!

Назад к оглавлению

Это уже философско-политический аспект — он про власть и контроль. И здесь очень легко уйти в крайности. Особенно когда разговор заходит о концентрации технологий в руках крупных корпораций. Дальше обычно следуют эмоциональные лозунги про «корпорации зла», «цифровое рабство» и прочие сценарии тотального порабощения. И спор почти неизбежно скатывается в примитивный политический срач. Хотел бы я тут возразить, что «всё будет хорошо», но такая позиция тоже будет наивной крайностью.

Но если убрать софистику, остаётся вполне серьёзный вопрос. Как я уже отмечал ранее, мощные ИИ модели действительно требуют огромных ресурсов. Всё это — крен в сторону усиления роли больших корпораций и государств — ведь такие бюджеты доступны не многим. Параллельно возникают и риски милитаризации технологии, deepfake-манипуляций, алгоритмической монополизации, автоматизации пропаганды. И эти опасения не выйдет списать на теории заговора — ведь примеры уже есть. Поэтому этот аргумент имеет под собой основания.

Например, в январе 2024 года избирателям в американском штате Нью-Гэмпшир пришли звонки от ИИ-ботов с синтезированным «голосом» Джо Байдена, которые убеждали людей не идти на праймериз; позже Федеральная комиссия по связи США назначила организатору многомиллионный штраф — и этот кейс стал наглядным примером того, как deepfake уже превращается в реальные политтехнологии. [Источники]

По линии милитаризации «конфликт интересов» тоже уже не теория. Согласно инсайдам новостного вебсайта Axios Министерство Обороны США ведёт переговоры с поставщиками ИИ-моделей о доступе к ним и сценариях их военного применения, и это уже создало трения с компанией Anthropic, которая исторически старалась держать более жёсткие страховочные ограничения по линии своей политики использования. [Источники]

[МОЛНИЯ!] Open AI и Пентагон

Назад к оглавлению

По последним данным из СМИ OpenAI договорилась об использовании своих ИИ-моделей Пентагоном вместо Anthropic.

По словам Альтмана, на которые ссылается CNBC, компании OpenAI удалось договориться с Министерством обороны США об условиях использования её разработок в секретных системах данного ведомства. «На всех этапах нашего взаимодействия Министерство обороны выражало глубокое уважение к безопасности и стремление к сотрудничеству с целью достижения максимально благоприятных итогов», — сообщил Альтман в своей публикации на страницах социальной сети X.

Напомним, что нежелание Anthropic разрешить Пентагону использование своих разработок без предусмотренных компанией этических ограничений привело к отказу ведомства от контракта с компанией на $200 млн, а также включению Anthropic в список сомнительных поставщиков, представляющих угрозу для национальной безопасности. Всем американским правительственным структурам велено незамедлительно прекратить использование чат-бота Claude, и в течение шести месяцев найти альтернативу.

Что характерно, Сэм Альтман заявил о готовности Министерства обороны США соблюдать предусмотренные OpenAI ограничения на использование ИИ. Два принципа, вокруг которых разразился спор между Пентагоном и Anthropic, найдут отображение в тексте контракта с OpenAI и будут соблюдаться американским оборонным ведомством, как заявил глава компании. Речь идёт о неприменении ИИ для массовой слежки за американскими гражданами и неиспользовании ИИ для управления полностью автономными системами вооружения, которые способы истреблять людей без санкции человека. По словам Альтмана, OpenAI позаботится о том, чтобы эти принципы соблюдались государственным заказчиком. За безопасность в этой сфере будут отвечать отдельные специалисты на стороне OpenAI.

Попутно Альтман призвал Пентагон распространить такие условия сотрудничества на все компании в сфере ИИ, чтобы устранить возникшие противоречия с некоторыми участниками рынка. Представители Anthropic выразили глубокое разочарование решением Пентагона о включении их компании в список неблагонадёжных поставщиков. Разработчик оставляет за собой право оспорить данное решение в суде.

Драма, которая развивалась вокруг несогласия руководства Anthropic с бесконтрольным использованием ИИ американскими военными, получила новый этап развития вечером в пятницу, когда глава OpenAI Сэм Альтман подтвердил достижение договорённости с Пентагоном об адаптации решений этой компании под нужды ведомства. [Источник]

При этом важно не впадать и в другую крайность — мол, «всё пропало, корпораты всех захватят, и мы будем жить в мире, представляющем из себя что-то среднее между миром Джорджа Оруэлла и Киберпанка».

История показывает: любая мощная технология используется и во благо, и во зло. Интернет дал доступ к знаниям и одновременно стал мощным инструментом мошенничества и дезинформации. Социальные сети подарили людям удобную связь, но усилили поляризацию и обострили проблемы травли и новомодной «отмены». Атомная энергия даёт электричество, но и используется при создании самого разрушительного в мире оружия. Печатный станок обеспечил просвещение миллиардам людей, но максимально упростил и усилил самую чудовищную пропаганду. Технологии — не зло сами по себе. Они усиливают возможности — но вместе с ними и ответственность.

Довольно бессмысленно спорить о том, будет ли ИИ использован во зло. Практически любая мощная технология кем-то и где-то будет использована недобросовестно. Вопрос в другом: какие институты существуют вокруг неё, насколько прозрачны процессы, как устроено регулирование и распределение власти. Проблема здесь институциональная и правовая, а не философская. В конце концов в мире прекрасно существуют страны даже с такой спорной на первый взгляд, вещью как свободный рынок огнестрельного оружия.

Да, концентрация вычислительных мощностей в руках ограниченного числа игроков на рынке создаёт дисбаланс. Но это уже разговор о конкурентной политике, открытых моделях, стандартах прозрачности, ответственности разработчиков и государств. Это сложная тема, требующая конкретных механизмов регулирования, а не громких эмоциональных лозунгов.

И если говорить откровенно, то проблема тут в том, насколько общество способно выстроить правила вокруг мощной технологии быстрее, чем она станет повсеместной и наворотит нам проблем.

Да, опасения — не мифические. И очень скоро встанет важный вопрос: что делать, и как с этим дальше жить.

Аргумент № 10. ИИ навязывают насильно!

Назад к оглавлению

Одни из самых странных и абсурдных ситуаций, происходящих в эпоху ИИ, — это принуждение сотрудников компаний его использовать как обязательную норму «сверху». На мой взгляд, это истинное самодурство.

Яркий пример подобного управленческого абсурда — ситуация вокруг компании Electronic Arts («фигурант дела» почему-то даже не удивляет : D). По сообщениям в прессе EA заставляла 15 000 своих сотрудников использовать ИИ буквально «для всего» — от написания кода и создания концепт-артов до управленческих задач вроде подготовки сценариев разговора с подчинёнными о повышении зарплаты или карьерном росте. Это уже истинный гротеск маразма — попытка стандартизировать само мышление сотрудников. [Источник]

Парадокс в том, что ИИ позиционируется как средство повышения эффективности. Но иногда его начинают навязывать там, где он не нужен или даже вреден. Хотели, как лучше, а получилось — как всегда. И вместо реального повышения эффективности — формальный плюсик: «использовал ИИ — молодец». Это уже не прогресс, а имитация. Просто потому что «так теперь модно» или «руководство требует внедрения». В итоге страдает и результат, и мотивация людей.

Ситуация с EA — показательный кейс того, как неэтичным может быть не сам факт применения новейшей технологии, а способ её внедрения. Технология тут, по сути, уже перестаёт быть инструментом, а становится почти что религиозным ритуалом.

Но одинаково странно — как требовать от всех использовать ИИ, так и запрещать его использовать из принципа. В обоих случаях решение принимается не на уровне здравого смысла, а на уровне идеологии.

Каждый специалист работает в своём контексте. Где-то ИИ действительно экономит часы времени. Где-то он создаёт больше проблем, чем решает: требует дополнительных перепроверок, ломает стиль, рушит структуру, добавляет шум.

Поэтому решение, когда и как применять определённый инструмент, должно оставаться за профессионалом, который несёт ответственность за конечный результат.

Аргумент № 11. ИИ провоцирует конфликты!

Назад к оглавлению

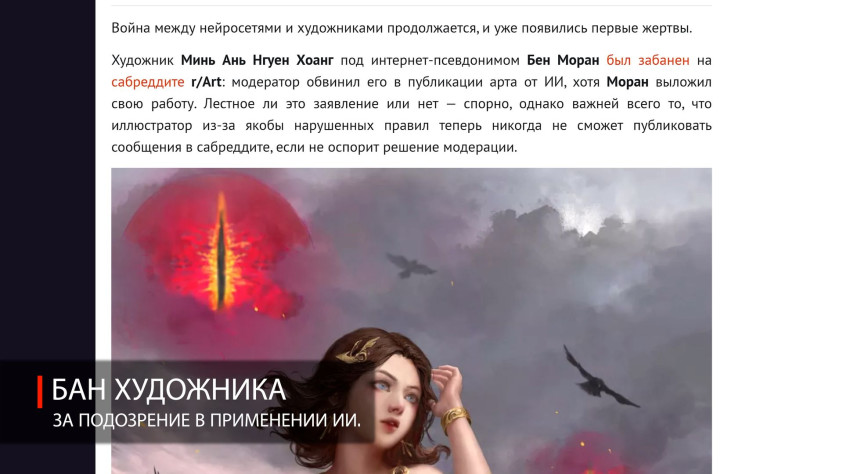

Одна из самых неприятных и болезненных ситуаций, которые массово начали происходить после появления генеративного ИИ, — это ложные обвинения авторов в его использовании. Причём речь не о троллинге в комментах, а о серьёзных репутационных скандалах, банах и публичной травле.

Так, в 2023 году особенно часто всплывали конфликты вокруг художников. Например, на Comiket 102 иллюстратор Руи Араизуми представил новый артбук с артами по разным аниме франшизам. Почти сразу в X (бывший Twitter) его начали обвинять в том, что финальная иллюстрация якобы создана с помощью ИИ. Он вынужден был опубликовать скриншоты процесса работы и видео, демонстрирующее создание рисунка. Фактически художнику пришлось доказывать, что он действительно нарисовал свою же работу. Источник]

Похожая история произошла с художником Минь Хоангом, известным под псевдонимом Бен Моран. Его забанили на сабреддите r/Art — модератор решил, что опубликованная работа сгенерирована нейросетью. Попытка спокойно разобраться закончилась грубым отказом модератора. История вышла за пределы локального конфликта, художники устроили протест, сабреддит временно ушёл в приват, а пользователи продолжали публиковать сообщения с критикой модерации, не стесняясь в выражениях. [Источник]

Можно, конечно, обвинить ИИ в том, что он начинает провоцировать конфликты. Но формально — это всё-таки человеческий фактор. С приходом ИИ меняется сама атмосфера доверия. Возникает чрезмерная подозрительность. Если работа выглядит «слишком чистой», «слишком идеальной» или просто «слишком похожей на нейростиль» — автор уже автоматически попадает в опалу.

Это парадоксальная ситуация. Технология, которая должна была стать удобным и полезным инструментом, начинает работать как чёрное клеймо. Художнику теперь недостаточно просто хорошо рисовать — он должен быть готов доказать, что процесс происходил вручную. Возникает новая презумпция виновности: «сначала докажи, что ты не ИИ».

Это уже социальная деформация. Мы наблюдаем, как меняется сам климат профессиональных сообществ. Появляется нервозность, повышенная чувствительность, иногда — агрессивная «защита территории». И в каком-то смысле это объяснимо: люди чувствуют угрозу профессии, идентичности, будущему. И последствия выражаются в конфликтах между самими людьми.

ИИ действительно стал катализатором напряжения. Но опять же — он не создаёт конфликт из ничего. Он усиливает и обостряет уже существующие страхи и конкуренцию.

С одной стороны, существуют реальные случаи, когда работы выдаются за «ручные», будучи полностью сгенерированными. С другой — массовая «охота на ведьм» разрушает доверие внутри сообществ. И в итоге страдают именно живые авторы. Необоснованные публичные обвинения часто имеют риск переходить в настоящую травлю. Именно поэтому я так топлю за то, чтобы не впадать в крайности и спокойно разбираться в ситуации.

И если в предыдущих блоках мы говорили об экономике, экологии и философских аспектах, то здесь речь идёт уже о человеческом факторе. О доверии. О добросовестности. О том, как разные сообщества реагируют на новую технологию — через адекватный диалог или через чрезмерную подозрительность и конфликты.

К слову, не ИИ устраивает травлю. Это делают люди. И, возможно, именно тут фактор «человечности» становится особенно ироничным.

Недавно я досмотрел мини-сериал «Во всём виновата она», и, хотя, тамошний сюжет не имеет абсолютно никакого отношения к теме ИИ, но он, по сути, про сложные отношения между людьми, и монолог одной из героинь в конце последней серии меня очень впечатлил:

Но я… Теперь понимаю…

Почему люди злятся друг на друга…

Кричат, когда что-то идёт не так.

Почему мы начинаем кого-то винить? Хотя не знаем ничего.

Это нас утешает.

Мы чувствуем себя хорошо, думая, что… Кого-то накажут.

Тогда мы думаем об их боли… Не о нашей.

Это мерзко.

Потому что ткнуть в кого-то пальцем — приятно.монолог Лии Ирвайн из сериала «All Her Fault» (2025)

Фактор человечности

Назад к оглавлению

На днях у меня состоялась интересная дискуссия об ИИ в нашем небольшом чатике разработчиков кастомных уровней для Tomb Raider в Дискорде. Она вдохновила меня на отдельный раздел в этом блоге. И здесь хочется поговорить уже о более философском аспекте — о факторе «человечности».

Что показательно, случившаяся дискуссия оказалась миниатюрной моделью того, как в реальности думает аудитория — с разными и порой даже парадоксальными мнениями и ощущениями.

Первое, что стало очевидно, — проблема терминов. В разговоре прозвучала важная ремарка, что раньше под ИИ понимали алгоритмы, которые управляют поведением врагов в играх или оптимизируют процессы. Сейчас же под «ИИ» многие подразумевают исключительно генерацию картинок, текста и аудио. И в этом расхождении уже заложен источник конфликта. Когда я говорю об ИИ как о широком технологическом поле, часть аудитории слышит про «ИИ картинки» и «ИИ озвучку». Возникает ощущение подмены понятий. И спор в итоге идёт не о технологии в целом, а о конкретных формах её существования — причём, часто это просто подразумевается и не проговаривается вслух. Тут есть и моя ошибка — это стоило предвидеть и конкретизировать.

Второй аспект — куда интереснее. На вопрос: в чём же технически отличие «найма человека» от «найма ИИ» для выполнения работы, которую ты не можешь выполнить сам, один из участников честно сформулировал позицию так: «Пока у меня нет аргументов, кроме того, что душа не принимает». И это, на самом деле, очень показательная фраза. Это не рациональный довод, а культурная реакция. Часто сопротивление ИИ — не про правовые нюансы, не про экономику и даже не про качество контента или логику. Это про ощущение аутентичности. Люди опасаются не столько самой технологии, сколько исчезновения «человеческого следа» — ощущения, что за произведением стоит живой человек со своим опытом, ошибками, характером.

И тут возникает тонкий момент. Даже если зритель или игрок формально не может отличить работу, созданную при помощи ИИ, от полностью «ручной», это не значит, что он не чувствует разницы. В дискуссии всплыла интересная аналогия с кино и компьютерными спецэффектами. Не секрет, что в старых фильмах, к примеру, часто использовали кукольную анимацию монстров и настоящие взрывы. Сейчас такой подход считается устаревшим, но иногда кажется, что он был лучше, натуральнее, убедительнее. На уровне зрения, слуха и логики ты можешь не определить, где именно использованы CGI эффекты, а где — более натуралистичные. Но иногда картинка всё равно ощущается будто бы «мёртвой». Из-за перцепции. Т.е. из-за более глубокого чувственного восприятия. Это очень тонкий эстетический нюанс.

Ещё один сильный момент — конфликт ролей. Прозвучала фраза: «Как потребитель контента я категорически против ИИ, но как разработчик — всеми руками за». И это почти идеальная иллюстрация двойственного отношения к ИИ. Как потребитель ты боишься обесценивания, шаблонности, потери уникальности. Как создатель ты видишь инструмент, который помогает существенно облегчить и ускорить работу, компенсировать собственные недостатки и реализовать свои самые смелые идеи. Один и тот же человек, две разные позиции — и два разных отношения к технологии. Одновременно. Подобные противоречия в целом довольно свойственны нашей человеческой природе.

И, наконец, философский вопрос границ. Где проходит черта между просто инструментом и полной заменой? Вспоминая парадокс корабля Тесея — если заменить все доски на корабле — это будет всё ещё тот же самый корабль или уже другой? Когда ИИ помогает — это усиление. Когда он делает «слишком много» — это уже подмена. А «слишком много» — это сколько? Чёткой границы тут нет. И признание этой размытости будет честнее, чем попытка провести её искусственно.

Отдельно я бы отметил, что неприятие ИИ-контента не всегда выливается в агрессию. Это может быть просто тихое эстетическое непринятие. Подсознательное отторжение продукта, созданного с помощью нейросетей. Это более глубокий слой, чем просто хейт. Это вопрос культурной ценности и того, что мы считаем «настоящим».

И, пожалуй, самый важный инсайт из этой дискуссии как раз в том, что значительная часть сопротивления ИИ рождается не из экономических, экологических или логических аргументов. Оно рождается из ощущения: «Это не настоящее». Это внутренний когнитивный диссонанс, выливающийся в целый культурный феномен.

И если об этом не говорить честно, сводя всё только к цифрам и законам, разговор неизбежно будет поверхностным. Потому что помимо рациональных аргументов, есть ещё и чувства — и зачастую именно они формируют отношение людей куда сильнее любых логических или правовых доводов.

Выводы и что делать?

Назад к оглавлению

Переходим к выводам. И начать, как мне кажется, стоит с честного признания границ нашего влияния. Мы можем повернуть время вспять и «выключить» ИИ? Можем остановить технический прогресс? Можем в одиночку перетряхнуть глобальный рынок или переделать мировую экономическую систему? Очевидно, что нет. Джина обратно в бутылку запихнуть уже нельзя.

Технологическая волна уже запущена. ИИ — это уже давно не эксперимент в лаборатории и не временный тренд. Это инфраструктура, которая постепенно встраивается в экономику, медиа-среду, образование, разработку, игры. Можно спорить о темпах, о формах внедрения, о правилах — но сам факт его существования и масштабирования уже не обсуждается.

Значит ли это, что мы бессильны? Тоже нет.

Да, мы не можем напрямую влиять на макроуровень. Но мы можем влиять на формат разговора. Мы можем не молчать, поднимать реальные проблемы, требовать прозрачности, обсуждать регулирование, формировать культуру ответственности. Мы можем поддерживать зрелую дискуссию вместо того, чтобы плодить эмоциональный, но бесполезный шум.

Громкие лозунги вроде «ИИ — зло», «корпорации всё захватили» или «технологии уничтожают человечество» создают иллюзию борьбы, но не приближают реальных решений. Поиск универсального виноватого — будь то корпорации, государства, экономическая модель мира или сама технология — даёт эмоциональную разрядку, но не меняет реальность.

Эмоциональные обвинения — плохой способ решения проблем.

И это не призыв смириться, замолчать и «принять всё как есть». Наоборот. Критика необходима. Контроль необходим. Разговор о концентрации власти, прозрачности, правилах рынка и ответственности — необходимы. Но паника и демонизация почти всегда упрощают проблему до карикатуры, а следовательно — мешают её решать.

Опасность не в самих новых технологиях как таковых. Опасность — в концентрации власти без должного контроля, в отсутствии прозрачности, в слабом регулировании и в эмоциональной поляризации общества.

Тут будет к месту вспомнить кейс с забастовкой актёров из профсоюза SAG AFTRA. В первой части блога я упоминал это вскользь, потому что тема казалась уже избитой. И, возможно, это была моя ошибка. На ней стоило остановится подробнее, потому что это действительно очень показательный пример того, как сложные конфликты вокруг ИИ можно решать не через истерику, а через институциональные механизмы.

Конфликт актёров со студиями был жёстким. На кону стояли вопросы применения ИИ для воспроизведения голоса и внешности без полноценного контроля и отдельного разрешения со стороны исполнителей — всё это напрямую затрагивало их профессию и будущее. Поводов для эмоций было более чем достаточно.

Но профсоюз действовал спокойно, организованно и в правовом поле. Чётко формулировал требования, вёл переговоры, отстаивал интересы своих членов. И к забастовке прибегли только как к крайней мере — после того, как прямые переговоры не дали результата. И тут важно подчеркнуть: забастовка — это не истерика. Это вполне законный инструмент защиты своих прав и интересов.

В итоге конфликт был урегулирован. Потому что грамотно была выстроена переговорная позиция, были сформулированы конкретные требования, и стороны пришли к соглашению.

Именно поэтому институт профсоюзов я считаю одним из самых эффективных механизмов решения подобных проблем в нашем современном обществе. Когда у профессионального объединения есть структура, способная вести диалог с индустрией и государством, технологические скачки перестают быть стихийным бедствием.

К сожалению, институты профсоюзов работают не везде одинаково эффективно. Однако, ключевой принцип остаётся неизменным: ответом на проблему должна быть не истерика, травля несогласных или хаотичный протест, а организованная и грамотно выстроенная защита интересов.

ИИ можно ненавидеть, можно бояться, можно критиковать. Но куда продуктивнее — формировать механизмы, которые позволят обществу договариваться о честных правилах его использования. И пример SAG-AFTRA явно демонстрирует, что это не теория о сферическом коне в вакууме, а вполне реальная рабочая модель.

Ещё один показательный пример того, как действительно острые и поляризующие вопросы могут решаться без истерики, — это споры вокруг авторского права. В конце 90-х и начале 2000-х, на заре массового распространения Интернета, эта тема стояла почти так же остро, как сегодня стоит вопрос об ИИ.

Тогда ситуация тоже казалась безнадёжным тупиком. Интернет стремительно рос, цифровые копии распространялись мгновенно, музыка и фильмы массово скачивались, а правообладатели заявляли о катастрофе для индустрии. Авторы контента требовали защиты своих прав и справедливого вознаграждения. Пользователи, в свою очередь, опасались цензуры, тотального контроля и ограничения свободы распространения информации. Конфликт интересов был жёстким и эмоциональным.

По сути, это был системный шок: новая технология быстро разрушила привычную модель распределения ценностей. И общество было вынуждено искать баланс между доступностью информации и защитой труда авторов.

Но важно то, как этот конфликт в итоге разрешался. Не через запрет Интернета и не через отмену авторского права. Т.е. не через тотальную победу одной стороны над другой. Долгие переговоры, поиск компромиссов, судебная практика, постепенная корректировка законодательства, новые бизнес-модели, лицензирование, стриминговые сервисы, онлайновые игровые магазины — всё это формировалось постепенно и в правовом поле. И да — всё это было предельно долго и максимально скучно.

Да, до сих пор существуют споры, но базовый баланс в большинстве стран был выстроен достаточно цивилизованно. Индустрия адаптировалась, пользователи получили легальные альтернативы, а правовая система постепенно подстроилась под новую реальность.

И в этом смысле параллель с ИИ довольно очевидна. Мы снова находимся в точке мощного технологического сдвига, который ставит под вопрос существующие нормы. И снова звучат максимально резкие формулировки. Но если история чему-то и учит, так это тому, что самые острые конфликты вокруг технологий решаются долгими поисками баланса и компромиссов и скучной работой в правовом поле.

Это не самый зрелищный путь. Но именно он, как правило, оказывается самым устойчивым.

Направление ветра нам не подвластно. Но мы можем развернуть паруса так, чтобы заставить наш корабль плыть в правильном направлении. И для этого нужны не эмоции, а аргументированный и спокойный разговор.

На этом всё, друзья! Поделитесь своим мнением об ИИ и нашим будущем в комментариях! Не забывайте, поставить лайк, если ролик вам понравился и подписаться на канал и другие мои социальные сети.

И… До встречи… на просторах… Стоп…Гейм…Ру…

Назад к оглавлению

![Об этике в эпоху ИИ [2] — экономика, власть и человечность](https://images.stopgame.ru/uploads/images/515750/form/2026/03/01/r847x474/cRGFGVL3RyNlVtVovSmvcA/11da9567e809b3ad38d8d80531b52eb0.jpg)

Лучшие комментарии